- Artykuł odnosi się do stanu prac nad nowelizacją ustawy o zarządzaniu kryzysowym w zakresie określonym w druku sejmowym nr 405

Stan na 26-10-2020

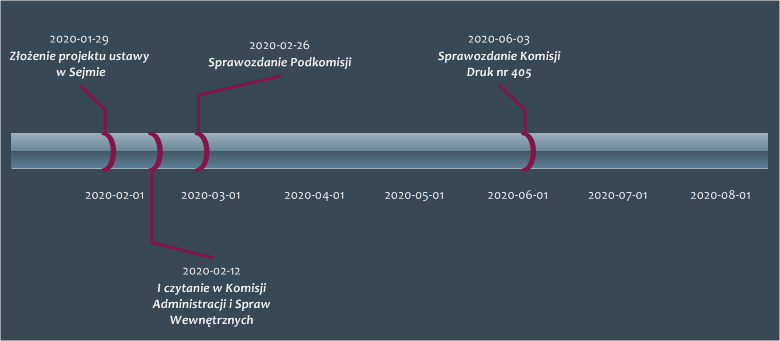

W sejmie trwają prace nad projektem ustawy o zmianie ustawy o zarządzaniu kryzysowym oraz niektórych innych ustaw. Jak dotychczas prace przebiegały następująco:

Cóż, z oczywistych powodów od dnia 3 czerwca prace nie posuwają się do przodu. Trudno też prognozować, kiedy Sejm zajmie się nowelizacją ustawy.

Z treści Sprawozdania Komisji Administracji i Spraw Wewnętrznych (druk nr 405) wynika, że w ustawie o zarządzaniu kryzysowym, o ile Sejm i Senat nie zdecydują inaczej, pojawią się nowe elementy. Proponowanych zmian jest sporo, począwszy od zmiany definicji sytuacji kryzysowej. Chcemy jednak zwrócić szczególną uwagę Czytelników na te fragmenty, które w sposób jawny i bezpośredni dotyczą ryzyka i zarządzania ryzykiem.

Modyfikacje definicji

zaproponowano zmianę definicji sytuacji kryzysowej. Aktualnie definicja ta brzmi następująco:

„należy przez to rozumieć sytuację wpływającą negatywnie na poziom bezpieczeństwa ludzi, mienia w znacznych rozmiarach lub środowiska, wywołującą znaczne ograniczenia w działaniu właściwych organów administracji publicznej ze względu na nieadekwatność posiadanych sił i środków”

Proponowana treść:

„należy przez to rozumieć sytuację wpływającą negatywnie na poziom bezpieczeństwa ludzi, mienia w znacznych rozmiarach, środowiska lub dziedzictwa kulturowego, wywołującą znaczne ograniczenia w działaniu właściwych organów administracji publicznej ze względu na nieadekwatność posiadanych sił i środków lub zakłócenia obsługi tych organów”

Zmienia się definicja pojęcia „mapa ryzyka”. Zamiast:

„należy przez to rozumieć mapę lub opis przedstawiający potencjalnie negatywne skutki oddziaływania zagrożenia na ludzi, środowisko, mienie i infrastrukturę”

proponuje się:

„należy przez to rozumieć mapę przedstawiającą obszar geograficzny objęty zasięgiem ryzyka lub opis tego obszaru, wraz ze wskazaniem wartości ryzyka”

Proszę zwrócić uwagę, to jest definicja odbiegająca od powszechnie rozumianego (w biznesie) pojęcia, które w tej ustawie określane jako „matryca ryzyka”. Co wydaje się właściwym rozwiązaniem.

Nowe pojęcia

W treści projektu wprowadzono do ustawy nowe pojęcia, nawiązujące do problematyki zarządzania ryzykiem:

ryzyko

„należy przez to rozumieć kombinację prawdopodobieństwa wystąpienia zagrożenia ze skutkami wystąpienia zagrożenia.”

ryzyko dla infrastruktury krytycznej

„należy przez to rozumieć kombinację prawdopodobieństwa wystąpienia zagrożenia lub podatności na wystąpienie zagrożenia ze skutkami wystąpienia zagrożenia”.

matryca ryzyka

„należy przez to rozumieć graficzny lub opisowy sposób przedstawienia kombinacji prawdopodobieństw wystąpienia zagrożeń z ich skutkami, ze wskazaniem wartości ryzyka.”

zarządzanie ryzykiem

„należy przez to rozumieć działania polegające na:

a) ocenie ryzyka, w tym:

– identyfikacji zagrożeń,

– analizie ryzyka,

– szacowaniu ryzyka,

b) planowaniu działań ograniczających ryzyko,

c) wdrażaniu działań ograniczających ryzyko,

d) osiąganiu gotowości do reagowania w przypadku wystąpienia sytuacji kryzysowej,

e) okresowej ocenie osiągniętych efektów.”

analiza ryzyka

„należy przez to rozumieć ocenę prawdopodobieństwa wystąpienia zagrożenia i opis jego możliwych skutków dla ludzi, gospodarki, infrastruktury, mienia w znacznych rozmiarach, środowiska lub dziedzictwa kulturowego, z uwzględnieniem scenariuszy zmian klimatu.”

szacowanie ryzyka

„należy przez to rozumieć określenie poziomu akceptacji ryzyka z uwzględnieniem wyników analizy ryzyka oraz posiadanych sił i środków w zakresie organizacyjnym, technicznym i finansowym.”

Plany zarządzania ryzykiem

Wprowadzono do sfery zarządzania kryzysowego nowy element – plany zarządzania ryzykiem. Póki co, zaproponowana definicja pojęcia „plany zarządzania ryzykiem” brzmi następująco:

„należy przez to rozumieć Krajowy Plan Zarządzania Ryzykiem, plany zarządzania ryzykiem ministrów kierujących działami administracji rządowej i kierowników urzędów centralnych oraz wojewódzkie, powiatowe i gminne plany zarządzania ryzykiem”

W projekcie ustawy następująco określono zawartość tych planów

„Art. 5ab. 1. Plany zarządzania ryzykiem zawierają:

1) charakterystykę zagrożeń, w tym zagrożeń dotyczących infrastruktury krytycznej uwzględnionej w wykazach, o których mowa w art. 5c pkt 1 lub art. 5f pkt 1;

2) opis zasad współdziałania między podmiotami wskazanymi w siatce bezpieczeństwa;

3) uporządkowaną listę działań na rzecz ograniczenia ryzyka katastrof w zakresie organizacyjnym, technicznym i finansowym, z uwzględnieniem:

a) hierarchii działań,

b) ram czasowych ich realizacji,

c) podmiotów wiodących oraz współpracujących przy ich wykonywaniu,

d) sposobów finansowania oraz wysokości nakładów finansowych,

e) oceny osiągniętych efektów oraz wniosków z wdrożonych działań.”

Określono również ogólną odpowiedzialność za opracowanie planów zarządzania ryzykiem:

„2. Plany zarządzania ryzykiem opracowują:

1) dyrektor Centrum – Krajowy Plan Zarządzania Ryzykiem;

2) ministrowie kierujący działami administracji rządowej – plany zarządzania ryzykiem ministrów kierujących działami administracji rządowej;

3) kierownicy urzędów centralnych – plany zarządzania ryzykiem kierowników urzędów centralnych;

4) wojewodowie – wojewódzkie plany zarządzania ryzykiem;

5) starostowie – powiatowe plany zarządzania ryzykiem;

6) wójtowie (burmistrzowie, prezydenci miast) – gminne plany zarządzania ryzykiem.”

I dalej:

„Art. 5ac. 1. Dyrektor Centrum, opracowując projekt Krajowego Planu Zarządzania Ryzykiem, uwzględnia plany zarządzania ryzykiem ministrów kierujących działami administracji rządowej, kierowników urzędów centralnych oraz wojewodów.

2. Minister właściwy do spraw rozwoju regionalnego opiniuje projekt Krajowego Planu Zarządzania Ryzykiem pod względem spójności z programami strukturalnymi.

3. Dyrektor Centrum przedkłada Radzie Ministrów projekt Krajowego Planu Zarządzania Ryzykiem.

4. Rada Ministrów przyjmuje Krajowy Plan Zarządzania Ryzykiem w drodze uchwały.”

W projekcie zapisano również, że Plany Zarządzania Ryzykiem zostaną sporządzone po raz pierwszy w terminie do dnia 8 sierpnia 2020 roku. Cóż, będzie trzeba zmienić ten zapis.

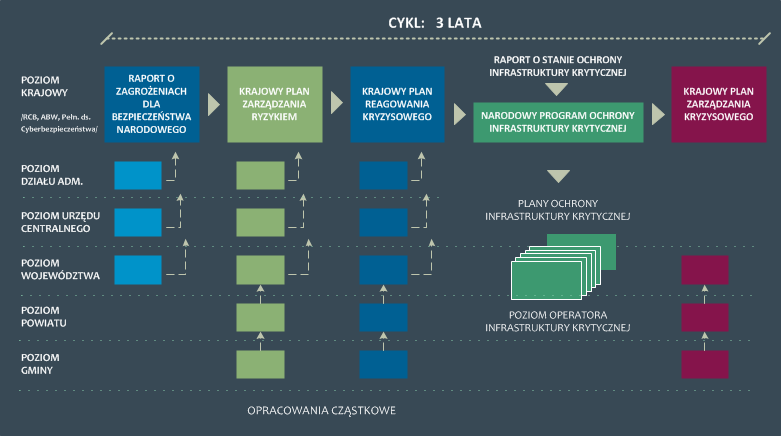

Produkty planowania zarządzania kryzysowego

Ustawa wskazuje zestaw dokumentów (raportów, planów …), które mają być opracowywane w ramach zarządzania kryzysowego. Cały proces analityczny i tworzenia (aktualizacji) dokumentów na być realizowany w cyklu 3-letnim:

Raport o zagrożeniach dla bezpieczeństwa narodowego

Opracowywany przez Rządowe Centrum Bezpieczeństwa, przy współudziale Agencji Bezpieczeństwa Wewnętrznego oraz Pełnomocnika Rządu ds. Cyberbezpieczeństwa. Towarzyszyć mu mają tzw. raporty cząstkowe, opracowywane przez wojewodów, ministrów i kierowników urzędów centralnych.

Na podstawie Raportu o zagrożeniach … mają powstawać kolejno:

Krajowy Plan Zarządzania Ryzykiem

Opracowywany przez Rządowe Centrum Bezpieczeństwa m.in. na podstawie planów cząstkowych.

Krajowy Plan Reagowania Kryzysowego

Opracowywany przez Rządowe Centrum Bezpieczeństwa m.in. na podstawie planów cząstkowych.

Narodowy Program Ochrony Infrastruktury Krytycznej

Opracowywany na podstawie „Raportu o stanie infrastruktury krytycznej” za rok poprzedni. Natomiast na podstawie Narodowego Programu Ochrony Infrastruktury mają być opracowywane – przez poszczególnych operatorów infrastruktury krytycznej – Plany Ochrony Infrastruktury Krytycznej. Również na podstawie rejestru – wykazu infrastruktury krytycznej.

Krajowy Plan Zarządzania Kryzysowego – ma powstawać w okresie maksymalnie 2 lat po opracowaniu Raportu o zagrożeniach dla bezpieczeństwa.

KPZK mają towarzyszyć – jak dotychczas – miejscowe plany, tj. wojewódzkie, powiatowe oraz gminne plany zarządzania kryzysowego.

Z lektury Druku nr 405 nasuwa się kilka wniosków:

Nie przewiduje się wymogu szczegółowego określenia struktury i zawartości Planu Zarządzania Ryzykiem (planów cząstkowych) w drodze Rozporządzenia Rady Ministrów. Może to doprowadzić do sytuacji, w której co Plan … to obyczaj. Jeżeli dzisiaj prześledzimy struktury lokalnych (gminnych, powiatowych i wojewódzkich) Planów Zarządzania Kryzysowego to z łatwością zauważymy ową dowolność wynikającą z bardzo ogólnikowego określenia struktury i zawartości.

Na przykład, tak zwany Plan Główny Planu Zarządzania Kryzysowego Miasta Gdańsk (z roku 2018) liczy 56 stron zaś Plan Główny Planu Zarządzania Kryzysowego Miasta Szczecin (rok 2020) liczy stron 300. Po tym już widać, że co samorząd to inna filozofia i inne podejście do tworzenia PZK. Spodziewamy się, że podobnie będzie w przypadku Planów Zarządzania Ryzykiem – przydałyby się jednak szczegółowe wytyczne tak by ułatwić samorządom pracę i doprowadzić do porównywalności analiz samorządowych.

Przypomnijmy, Druk nr 405 definiuje pojęcie „analizy ryzyka” następująco:

„należy przez to rozumieć ocenę prawdopodobieństwa wystąpienia zagrożenia i opis jego możliwych skutków dla ludzi, gospodarki, …”

Jeżeli popatrzymy do standardu ISO 22300 z roku 2018 (Security and resilience — Vocabulary) a mającego niewątpliwie związek z zarządzaniem kryzysowym to dowiemy się, że analiza ryzyka to:

Proces mający na celu zrozumienia charakteru ryzyka i określenie poziom ryzyka.

Nota 1: Analiza ryzyka stanowi podstawę oceny ryzyka i decyzji dotyczących reagowania na ryzyko.

Nota 2: Analiza ryzyka obejmuje oszacowanie ryzyka.

Pomińmy fakt, że ISO 22300 włącza w proces analizy ryzyka działanie określane jako oszacowanie ryzyka – tu wyodrębnione w projekcie nowelizacji ustawy. Istotne jest coś innego, otóż analiza ryzyka to nie tylko określenie poziomu ryzyka czyli – w tym przypadku – prawdopodobieństwa i skutków ale przede wszystkim rozpoznanie całej struktury ryzyka: charakteru przyczyn (źródeł – czynników ryzyka) i ich powiązań, charakteru i rodzaju potencjalnych zdarzeń (i ich powiązań) a także skutków: bezpośrednich i pośrednich. I – oczywiście – ich powiązań. Istnieje niestety ryzyko, że tak przeprowadzana analiza ryzyka jak zapisano to w projekcie zmiany ustawy może okazać się bardzo powierzchowną.